LLaMaやFalconといった小型の大規模言語モデル(LLM)が矢継ぎ早にリリースされる中、Microsoft ResearchのAI研究チームが、プレプリントサーバーのarXivで、Transformerベースのモデル「phi-1」を発表しました。このモデルは、パラメーター数がGPT-3.5の100分の1以下の13億しかないにもかかわらず、テスト用データセット・HumanEvalでGPT-3.5を上回る成績を収めたことが報告されています。

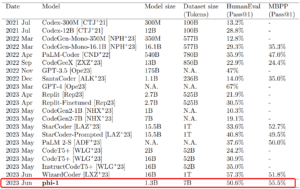

以下は、phi-1のパフォーマンスを他のモデルと比較したものです。phi-1はプログラミング能力を評価するためのデータセットであるHumanEvalで50.6%、MBPPで55.5%と、高い精度を示しました。この結果はGPT-4の67%には及びませんが、パラメーター数が1750億のGPT-3.5を上回るものでした。

phi-1がいかに軽量なのかについて、論文の著者のひとりであるセバスチャン・ビューベック氏は「他のHumanEval50%超えのモデルは1000倍も大きいです。例えば、WizardCoderはモデルサイズが10倍、データセットが100倍でした」と説明しています。

「Textbooks Are All You Need(必要なのは教科書だけ)」と題された論文によると、このモデルはインターネットから収集された教科書品質のデータセット60億トークンと、GPT-3.5から生成された教科書データセット10億トークンを使い、8台のNVIDIA A100によるわずか4日間のトレーニングで作られたとのこと。

※以下省略。記事全文はソース元にて

2023年06月22日 20時00分

https://gigazine.net/news/20230622-phi-1-large-language-model-microsoft/

■引用元記事

Microsoft Releases 1.3 Bn Parameter Language Model, Outperforms LLaMa

https://analyticsindiamag.com/microsoft-releases-1-3-bn-parameter-language-model-outperforms-llama/

■論文

Textbooks Are All You Need

https://arxiv.org/abs/2306.11644

(゚∀。)ナルヘソ

なんでGPT-3.5とか言ってんだ

人知を超えることを目的でやってるやつと

そこそこ性能をコンパクトにの違いやろな🥺

データ処理の技術ってだいたい似たようなアプローチになるよな。

最初は高性能を目指すんだけど、だんだん高性能なものは似たような品質になってきて区別がつきにくくなって、低性能でも高効率なものに関心が移りはじめる。

Windowsにチャットgpt搭載するから軽量化が必要なんだろ

そしてロボットに組み込まれるようになる

近い将来はプロジェクターに表示されたバスケットボールでシュートできるようになるの

コートの幅も解像度の可変のように自由自在に変更できる

こういったホログラフィックマッピングを使えば三次元で映像を映すことができる

これを使ってバーチャルキーボードがあるように、すでに接触によるポインティング動作が可能になっている

これができればバーチャファイターも3d空間でできるようになる

http

s://xr-hub.com/wp-content/uploads/2019/02/gif-32-2.gif

マリオ64のラジコンが出る

引用元: 【AI】Microsoftがたった13億のパラメーターでGPT-3.5超えのパフォーマンスをたたき出す「phi-1」を発表 [oops★]

![【セキュリティ】NEXCO西日本がUSBメモリ紛失 データは暗号化済……ただしパスワードは本体に貼り付け [香味焙煎★]](https://namasanroom.com/wp-content/uploads/2023/11/usb_memory_stick-150x150.jpg)

![【経済】株価 1000円以上値上がり デフレ脱却への期待で買い注文膨らむ [Ikhtiandr★]](https://namasanroom.com/wp-content/uploads/2024/03/デフレ-150x150.jpg)

![【動物】マンション20階からワニが落下…死亡 食用目的で飼育も逃げ出したか(中国) [煮卵オンザライス▲★]](https://namasanroom.com/wp-content/uploads/2023/06/wani_close-150x150.jpg)

![スマホ通販の「EXPANSYS」、メンテ中だったサイトが消滅? 支払い済みのユーザーは阿鼻叫喚 [香味焙煎★]](https://namasanroom.com/wp-content/uploads/2023/08/アリエク-150x150.jpeg)

![完璧な結婚相手でもクチャラーで無理 クチャラーって苛つくよな? [194767121]](https://namasanroom.com/wp-content/uploads/2024/02/restaurant_rich_couple-300x300.jpg)

![K-POPグループのリーダー、知的障がいを装い兵役逃れか…懲役1年・執行猶予2年を宣告 [朝一から閉店までφ★]](https://namasanroom.com/wp-content/uploads/2023/09/idol_man-300x168.jpg)

![【悲報】ビットフライヤー創業者「スイスで魚とワイン一杯頼んだら1万円。日本円よわよわw」 [419087453]](https://namasanroom.com/wp-content/uploads/2023/07/money_chingin_kakusa_man.jpg)

![【教育】「英語の時間が足りない」受験生悲鳴─24年共通テストは英語筆記の分量がセンター時代の"1.8倍"…問題量が年々増加 [デビルゾア★]](https://namasanroom.com/wp-content/uploads/2024/01/school_test_seifuku_girl-300x288.jpg)

![ダイソー商品、老舗玩具メーカー「うんち無限製造機」に酷似 パクったか?【画像】 [837857943]](https://namasanroom.com/wp-content/uploads/2024/01/unchi_character-300x300.jpg)

![「日本の地震は報い」発言の中国アナウンサー “解雇” 仕事失うも800万人のフォロワー得る… 3億1000万人が「いいね」 [煮卵★]](https://namasanroom.com/wp-content/uploads/2024/01/jishin_house-300x213.jpg)

![セクシー女優・京野美麗「過去に松本人志から強制猥褻行為を受けた。裁判で協力する」 [501864527]](https://namasanroom.com/wp-content/uploads/2024/01/csgHTdN-258x300.jpg)

![松本人志「ワイドナ出ます」 フジテレビ・吉本興業「聞いてないぞ」 [501864527]](https://namasanroom.com/wp-content/uploads/2024/01/松本人志-300x267.jpg)

![乙武さん、TENGAを公式からプレゼントされるもそれを動かす右手が無いことで困り果てる [632443795]](https://namasanroom.com/wp-content/uploads/2024/01/gVwbhqo-176x300.jpeg)

![タモリみたいな頭のいい人でも認知症になるんだな [837857943]](https://namasanroom.com/wp-content/uploads/2024/01/sunglass_normal-300x115.jpg)

![【悲報】炎上した海保機の通信士、任務が終わったら結婚する予定だった😭 [323057825]](https://namasanroom.com/wp-content/uploads/2024/01/airplane-300x195.jpg)

![マドンナ(65)に「お婆ちゃんもうやめて、見てて恥ずかしい」の声殺到 [632443795]](https://namasanroom.com/wp-content/uploads/2024/01/tlyJryA-188x300.jpeg)

![【能登地震】千羽鶴は被災地に送るべきではない?…「千羽鶴送付を禁止する法律を」との声も [おっさん友の会★]](https://namasanroom.com/wp-content/uploads/2024/01/origami_senbaduru-234x300.jpg)

![ほらかけるぞ!1、2、3!スーパーマーケットで30代女性に尿をかけた安田一二三容疑者逮捕 栃木 [866556825]](https://namasanroom.com/wp-content/uploads/2023/11/job_chinretsu_woman-300x294.jpg)

![私人逮捕系youtuber煉獄コロアキ チャンネル削除→月200万の不労所得が無くなった!と逆上www [509689741]](https://namasanroom.com/wp-content/uploads/2023/11/迷惑youtubere-300x300.jpg)

![「日本円の紙くず化は最終ステージに突入」 プレジデントオンライン [128776494]](https://namasanroom.com/wp-content/uploads/2023/10/money_weak_yen-300x283.jpg)

![女性「生理用品買うとき毎回複雑な気分になる。ハート柄、ピンク…限定的な女性像の押しつけはやめて」 [244661201]](https://namasanroom.com/wp-content/uploads/2023/11/UzhCxQt-235x300.jpg)

![亀田製菓「柿の種にピーナッツが混入したので回収します」 [866556825]](https://namasanroom.com/wp-content/uploads/2023/11/APkffXd-227x300.jpg)

![【闇深】櫻井翔もジャニーズ退社へ。キムタク以外全員退社する流れ [801948679]](https://namasanroom.com/wp-content/uploads/2023/11/XrfBvhk-300x219.jpg)

![電話に出られないから会社辞めます 20代の7割以上が苦手、言葉が出ず泣き出す人も…対策と電話の必要性 [ばーど★]](https://namasanroom.com/wp-content/uploads/2023/11/電話苦手-300x165.jpg)

![高齢男性、電車で泣く赤ちゃんに激高 親に「人間失格」と暴言 制止されるも「甘やかすから日本が駄目になる」…警察に引き渡される [ばーど★]](https://namasanroom.com/wp-content/uploads/2023/11/老害-256x300.jpeg)

![97歳運転の車がビルに突っ込む 「車に乗っていなかった」などと意味不明な説明 [135853815]](https://namasanroom.com/wp-content/uploads/2023/11/高齢者自己-300x132.jpg)

![【群馬】フィットネスジムの天井裏に侵入しシャワー中の女性の裸をのぞき見か 高校教諭の男を逮捕 [シャチ★]](https://namasanroom.com/wp-content/uploads/2023/11/TrDWNJF-178x300.jpg)

![【福島】「楽しくてやめられず」育児休業中に中古車販売で2億円稼いだ税務署職員に懲戒処分 [ぐれ★]](https://namasanroom.com/wp-content/uploads/2024/04/スクリーンショット-2024-04-26-20.57.07-300x168.jpg)

![引っ越し作業員に“心づけ”を渡す慣習を知って驚く若者たち「人件費はもう払ってる」「二度と会わない人たちなのに」 [おっさん友の会★]](https://namasanroom.com/wp-content/uploads/2024/04/スクリーンショット-2024-04-25-20.44.10-300x200.jpg)

![【栃木2遺体】逮捕の男「大金もらって引き受けた」 報酬目的の可能性 [PARADISE★]](https://namasanroom.com/wp-content/uploads/2024/04/スクリーンショット-2024-04-25-20.41.32-300x201.jpg)